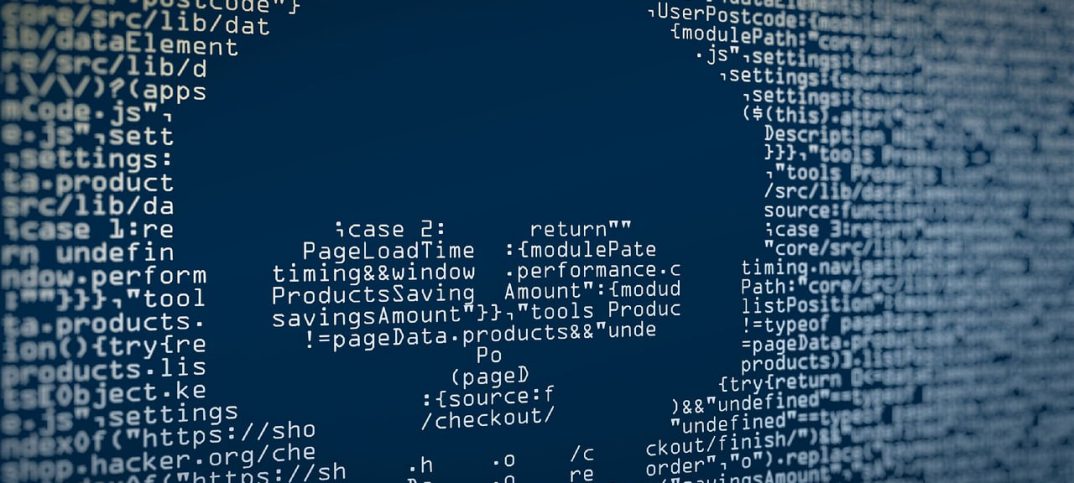

به گزارش سرویس بین الملل پایگاه خبری عدل البرز به نقل از hls.com، بر اساس گزارش جدیدی از سوی موسسه ملی استاندارد و فناوری (ایالات متحده)، انواع جدیدی از حملات سایبری وجود دارند که میتوانند سیستمهای هوش مصنوعی را «مسموم و آلوده» کنند.

سیستمهای هوش مصنوعی در جنبههای مختلف زندگی از رانندگی وسایل نقلیه گرفته تا کمک به پزشکان در تشخیص بیماریها و تعامل با مشتریان بهعنوان رباتهای گفتگوی آنلاین ادغام شده اند. برای انجام این وظایف، این مدلها بر روی حجم وسیعی از دادهها آموزش میبینند که به نوبه خود به هوش مصنوعی کمک میکند تا نحوه واکنش در یک موقعیت خاص را پیشبینی کند.

یکی از مسائل مهمی که در این گزارش برجسته شده، خراب شدن احتمالی این دادهها چه در طول دوره آموزشی یک سیستم هوش مصنوعی و چه پس از آن می باشد. این خرابی داده ها می تواند باعث اختلال در عملکرد هوش مصنوعی یا کار نکردن مستقیم آن شود.

بر اساس گزارش Techxplore، این گزارش چهار نوع اصلی از حملات را ارائه میکند و سپس آنها را بر اساس معیارهایی مانند: اهداف و مقاصد، تواناییها و دانش مهاجم طبقهبندی میکند.

حملات گریز پس از استقرار یک سیستم هوش مصنوعی رخ میدهند و سعی میکنند یک ورودی را تغییر دهند تا نحوه واکنش سیستم به آن را تغییر دهند (به عنوان مثال اضافه کردن علامتهایی به علائم توقف تا یک وسیله نقلیه خودران آنها را بهعنوان علائم محدودیت سرعت تفسیر کند).

حملات مسمومیت در مرحله آموزش با معرفی داده های خراب اتفاق می افتد (به عنوان مثال، درج نمونه های زیادی از زبان نامناسب در سوابق مکالمه به طوری که یک چت بات فکر می کند که آنها به اندازه کافی متداول هستند تا در تعاملات با کاربر خود استفاده کند).

حملات حریم خصوصی در حین استقرار رخ میدهد و شامل تلاشهایی برای یادگیری اطلاعات حساس در مورد هوش مصنوعی یا دادههایی ست که روی آن آموزش داده شده تا از آن سوء استفاده شود. عوامل مخرب میتوانند از چتبات سؤالات قانونی بپرسند و سپس از پاسخها برای مهندسی معکوس و یافتن منابع مدل استفاده کنند. اضافه کردن نمونه های ناخواسته به آن منابع آنلاین می تواند رفتار هوش مصنوعی را به طور نامناسب تغییر دهد. هنگامی که سیستم هوش مصنوعی از چنین نمونههایی یاد میگیرد، بسیار دشوار میشود که از یادگیری این نمونهها یا اصلاح رفتار آن جلوگیری کرد..

حملات سوءاستفاده ، درج اطلاعات نادرست به یک منبع (مانند صفحه وب یا سند آنلاین) می باشد که یک سیستم هوش مصنوعی این اطلاعات را جذب می کند. برخلاف حملات مسمومیت، حملات سوء سعی میکنند تا اطلاعات نادرستی را از یک منبع قانونی اما در معرض خطر به هوش مصنوعی ارائه دهند تا کاربرد اصلی سیستم هوش مصنوعی را تغییر دهد.

اکثر حملات ذکر شده نسبتاً آسان هستند و به حداقل دانش سیستم هوش مصنوعی و توانایی های محدود مخرب نیاز دارند. برای مثال، حملات مسمومیت را می توان با کنترل چند ده نمونه آموزشی که درصد بسیار کمی از کل مجموعه آموزشی می باشد، انجام داد.

دفاعی که کارشناسان هوش مصنوعی تاکنون برای حملات مخرب ابداع کرده اند، در بهترین حالت ناقص می باشد. بنابراین، آگاهی از این محدودیت ها برای توسعه دهندگان و سازمان هایی که به دنبال استقرار و استفاده از فناوری هوش مصنوعی هستند، مهم می باشد.

پایان پیام/

بیشتر بخوانید: نحوه کنترل ذهن سیستمهای هوش مصنوعی